En los últimos años, la inteligencia artificial (IA) ha dejado de ser solo una herramienta de automatización para convertirse en un factor decisivo dentro del ámbito de la ciberseguridad.

El punto de inflexión: IA capaz de vulnerar sistemas

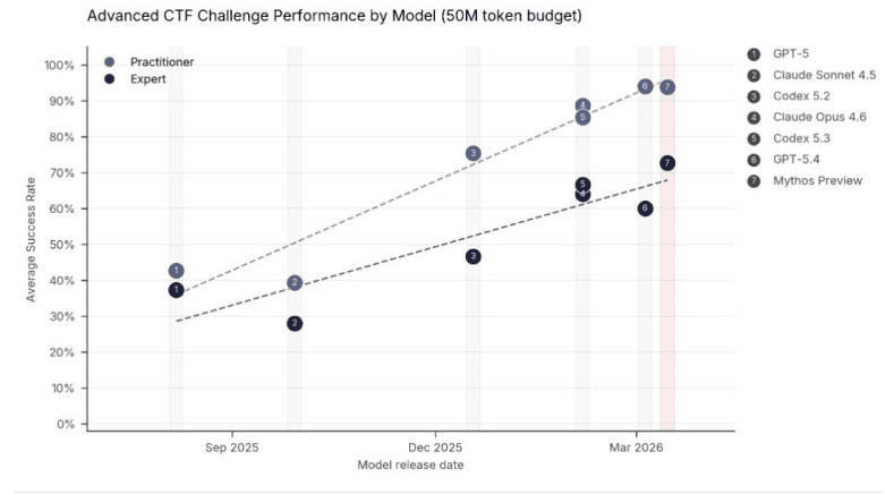

Uno de los casos más representativos es el desarrollo de modelos avanzados de IA como Claude Mythos. Este tipo de sistemas ha demostrado una capacidad sin precedentes para identificar vulnerabilidades en software, incluso aquellas que han permanecido ocultas durante décadas.

Más allá de la detección, lo realmente disruptivo es que estas IA pueden crear exploits funcionales de forma autónoma, reduciendo drásticamente el tiempo y conocimiento necesario para comprometer sistemas.

En pruebas reales, estos modelos han sido capaces de:

Detectar vulnerabilidades “zero-day”

Encadenar fallos para construir ataques complejos

Automatizar procesos que antes requerían equipos especializados

No por nada Claude se sitúa por encima en los rankings de resolución CTF.

Hoy, herramientas basadas en IA permiten que usuarios con poca experiencia puedan generar ataques funcionales en cuestión de horas.

Esto implica una democratización del cibercrimen, donde el conocimiento ya no es la principal limitante.

Un arma de doble filo: defensa vs ataque

A pesar de los riesgos, la IA también representa una de las mejores herramientas defensivas disponibles actualmente.

Modelos como los mencionados están siendo utilizados por grandes organizaciones para:

Detectar vulnerabilidades antes que los atacantes

Automatizar auditorías de seguridad

Reforzar infraestructuras críticas

De hecho, iniciativas colaborativas entre empresas tecnológicas buscan utilizar estas capacidades para parchar sistemas antes de que sean explotados.

Sin embargo, el problema es claro:

La misma tecnología que protege, también puede atacar.

¿Listo para dar el salto? Contáctanos

Leandro Inzunza

Analista de Ciberseguridad

CompunetGroup